【研究分享】关键短语提取技术调研及效果对比

认知计算部简介

作为中科闻歌的基础研究部门,认知计算研究部依托于中科闻歌多年来积累的媒体大数据、高性能云计算平台以及高素质技术人才,致力于将认知计算技术应用到广泛的业务场景中并推动前沿技术发展。我们的研究方向包括但不限于自然语言处理、计算机视觉、认知心理学、数据挖掘等。

前言

关键短语抽取是知识抽取和信息检索等信息技术的关键步骤。本文对现有的关键短语技术进行了调研和梳理,并针对典型的关键短语提取方法进行对比分析。相关关键短语提取技术已部署于闻海大数据平台中,并在新闻热点发现、文章关键信息总结、话题抽取等应用场景中发挥重要作用。

闻海大数据平台分析组件之热点词语、热点主题

技术背景

随着互联网文本相关数据呈指数级增长,如何快速有效地抽取和整理相关关键信息成为一个重要的研究课题。与关键词不同,关键短语可能由多个词组成,其文本语义描述更为丰富,表达更为完整。除此之外,关键短语构成了一个简洁的概念性文档摘要,有助于语义索引、文档聚类和分类等多个任务的效果提升。

关键短语提取技术方法

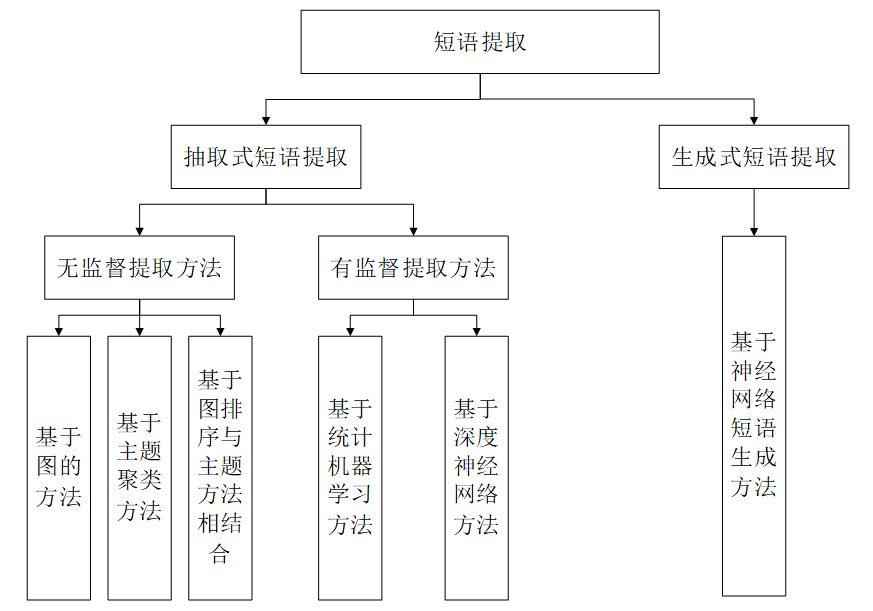

根据获取短语的方式的不同,现有的关键短语提取技术可以主要分为抽取式方法及生成式方法。

图 1 短语提取方法

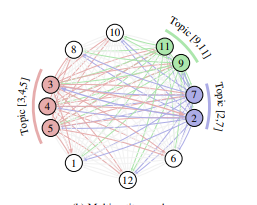

图2 多部图(Multipartite graphs)

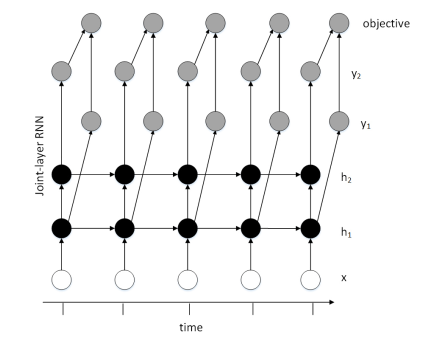

图3 联合层级递归神经网络模型

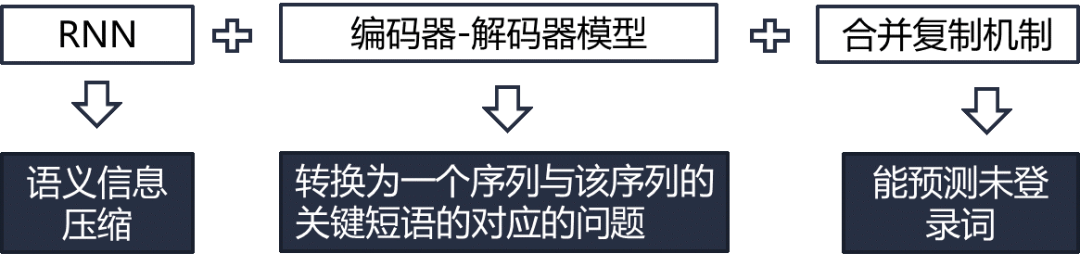

关键短语生成是关键短语提取的一个扩展,其优点在于能够明确地对文本中缺失关键短语进行预测并且进行文本语义的表达。近期的生成式短语提取方法大多是基于神经网络的。文献[10]提出的基于RNN的生成模型,首次将编码器-解码器模型应用于关键短语预测任务。该模型的主要组成如下图所示:

图4 基于RNN的生成模型

文献[11]则在文献[10]的基础上,针对RNN需要依赖时间进行计算因而比较耗时的缺点,提出了基于CNN的生成模型。该模型使用CNN网络替换RNN,并使用位置嵌入处理序列数据,并采用门控线性单元(GLU)作为非线性函数。

上述方法在计算过程中,实际上将标题与文本内容放在了同等重要的位置,这显然与实际的情况不符合。在此基础上文献[12]提出了基于Title-Guided Encoding方法。该方法的主要特点为:

1

标题另外作为类似查询的输入;

2

由标题引导的编码器收集从标题到文档中每个单词的相关信息。

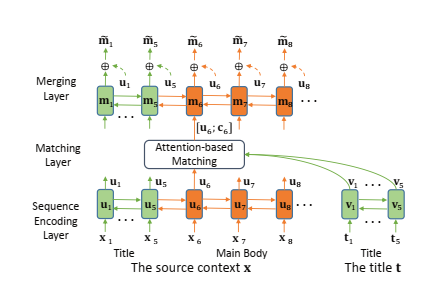

图 5 标题引导编码器模块

关键短语方法对比

由于有监督方法需要大量的标注数据,而数据的获取成本较高,因此本文选用无监督方法进行分析。无监督关键短语提取的方法可以分为基于图和基于主题的两类,因此我们分别选取了基于图的典型算法TextRank以及基于主题的算法TFIDF+LDA(综合TFIDF权重和LDA话题中短语分布概率两方面作用)分别作为获选短语的权重计算方法。

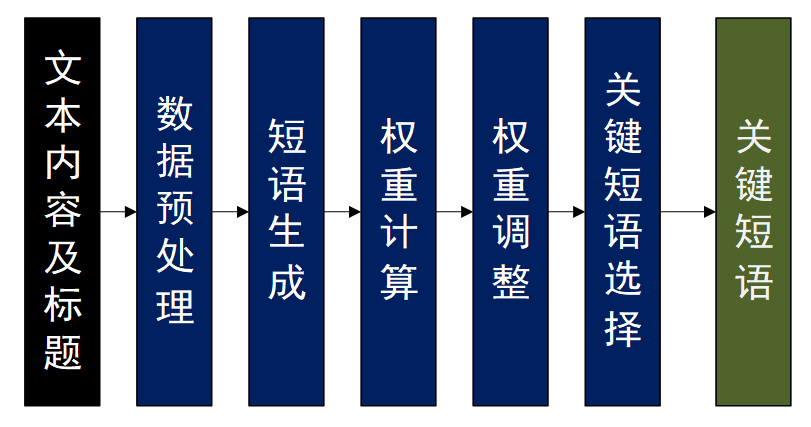

本文中短语抽取的流程主要包含数据预处理、短语生成、权重计算、权重调整及短语选择五部分。其实现流程如图6所示:

图 6 短语提取实现流程图

一

输入:

文本内容及文本标题。

二

数据预处理:

去除文本内容中的特殊字符并进行分词和词性标注。

三

短语生成:

对词性标签进行选择,选取有动词+形容词+名词、形容词+名词、动词+名词及名词词组构建候选短语。

四

权重计算:

使用TextRank或TFIDF+LDA方法进行短语权重计算。

五

权重调整:

检查候选短语是否存在于标题中,若存在将其权重加倍。

六

短语选择:

根据确定的关键短语数量及内部确定的权重参数阈值进行关键短语选取。

七

输出:

关键短语。

结果分析

我们在闻海大数据平台上以分别以“东京奥运会”和“阿斯利康公司”为检索关键词从新闻数据源中分别获取了约300篇新闻文章,并使用上述两种短语抽取方法进行短语抽取。两种方法的短语长度(即所包含的字数)均限定在5到25之间。

4.1

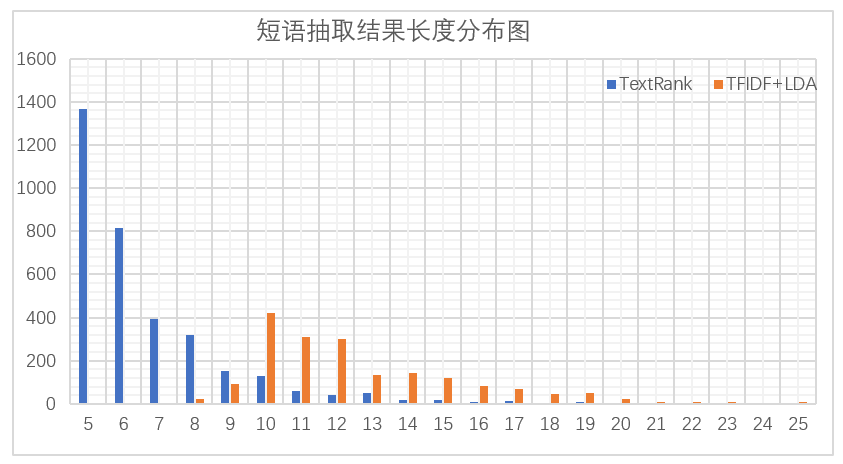

关键短语抽取结果长度比较

图 7 短语提取长度分布图

由分布图可知,使用TextRank方法抽取的短语大部分长度分布在9以下,而使用TFIDF+LDA方法获取的结果则主要分布在10到15之间。因此可知在抽取的较长短语时后者更具优势。

4.2

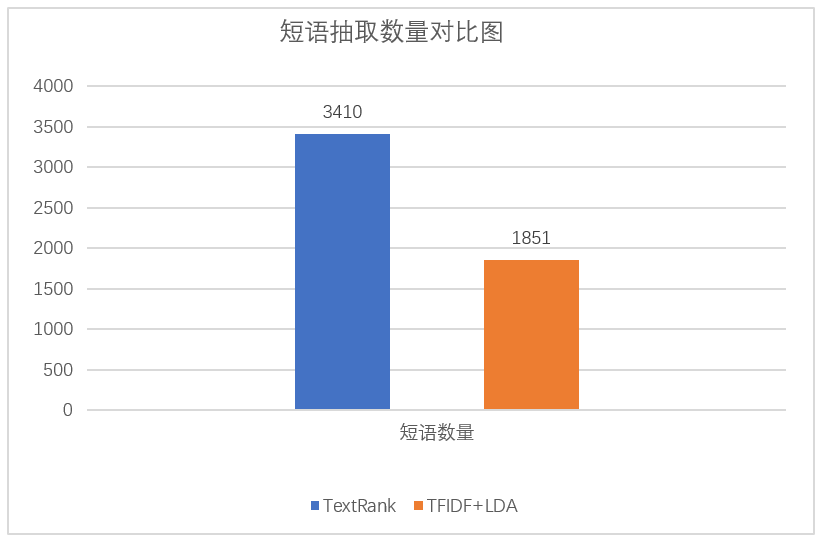

关键短语抽取数量比较

图 8 短语提取短语抽取数量对比图

图7为测试数据两种抽取方法的短语数量对比图,其中使用TextRank方法共获得短语3410条,使TFIDF+LDA方法共获取短语1851条。因此从短语的丰富度角度出发,使用TextRank方法更具优势。

4.3

关键短语提取结果内容比较

下面分别展示“东京奥运会”和“阿斯利康”两个专题的关键短语抽取内容比较结果。

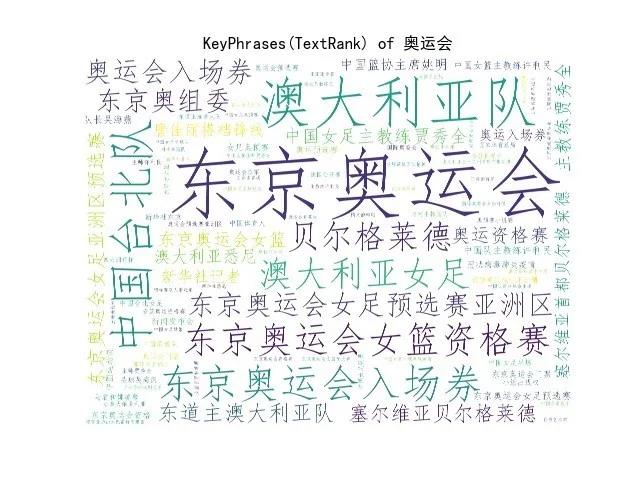

图 9 “东京奥运会”短语词云图-TextRank方法

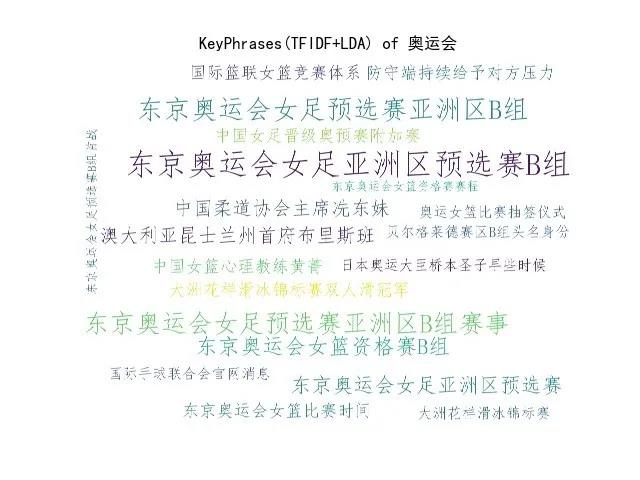

图 10 “东京奥运会”短语词云图-TFIDF+LDA方法

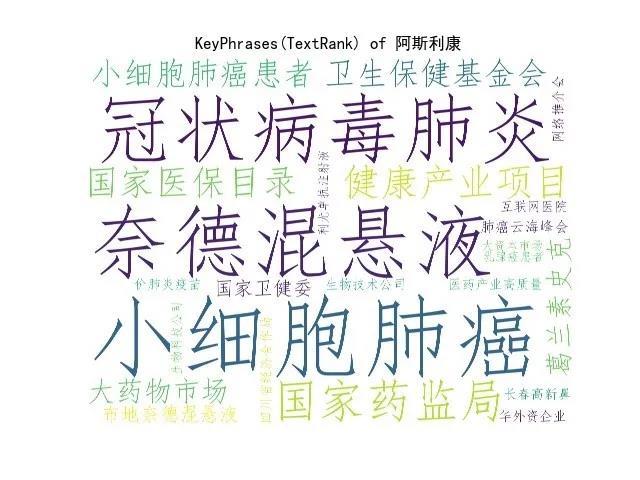

图 11 “阿斯利康”短语词云图-TextRank方法

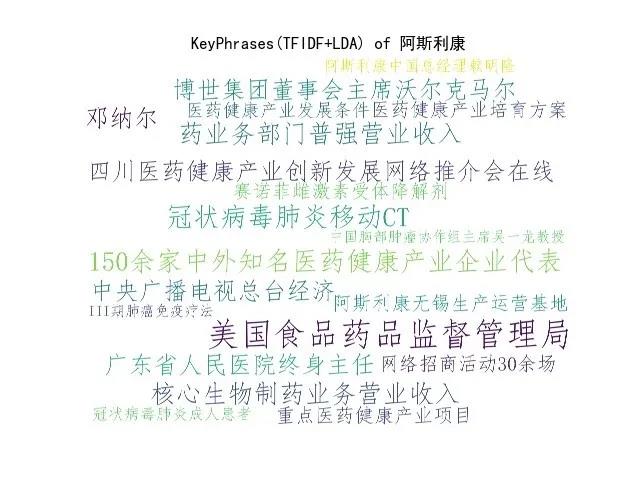

图12 “阿斯利康”短语词云图-TFIDF+LDA方法

由上述两个示例可知,基于TextRank方法获得的短语较短,但包含的集合文本的信息较TFIDF+LDA方法抽取的短语多,且短语整体的信息集合程度较高,便于用户获取海量文本的主要内容,较适合于文本聚类任务;而基于TFIDF+LDA方法抽取的短语信息较分散,但其单条短语含有较详细的文本信息,针对单篇文本时较能反映文本的主要内容,便于文本内容理解。

参考文献

[1] Papagiannopoulou E , Tsoumakas G . A review of keyphrase extraction[J]. Wiley Interdisciplinary Reviews: Data Mining and Knowledge Discovery, 2019.

[1] Wan X, Xiao J. Single Document Keyphrase Extraction Using Neighborhood Knowledge[C]//AAAI. 2008, 8: 855-860.

[2] Danesh S, Sumner T, Martin J H. Sgrank: Combining statistical and graphical methods to improve the state of the art in unsupervised keyphrase extraction[C]//Proceedings of the fourth joint conference on lexical and computational semantics. 2015: 117-126.

[3] Florescu C, Caragea C. Positionrank: An unsupervised approach to keyphrase extraction from scholarly documents[C]//Proceedings of the 55th Annual Meeting of the Association for Computational Linguistics (Volume 1: Long Papers). 2017: 1105-1115.

[4] Liu Z, Li P, Zheng Y, et al. Clustering to find exemplar terms for keyphrase extraction[C]//Proceedings of the 2009 Conference on Empirical Methods in Natural Language Processing: Volume 1-Volume 1. Association for Computational Linguistics, 2009: 257-266.

[5] Liu Z, Huang W, Zheng Y, et al. Automatic keyphrase extraction via topic decomposition[C]//Proceedings of the 2010 conference on empirical methods in natural language processing. Association for Computational Linguistics, 2010: 366-376.

[6] Teneva N, Cheng W. Salience rank: efficient keyphrase extraction with topic modeling[C]//Proceedings of the 55th Annual Meeting of the Association for Computational Linguistics (Volume 2: Short Papers). 2017: 530-535.

[7] Boudin F. Unsupervised keyphrase extraction with multipartite graphs[J]. arXiv preprint arXiv:1803.08721, 2018.

[8] Zhang Q, Wang Y, Gong Y, et al. Keyphrase extraction using deep recurrent neural networks on twitter[C]//Proceedings of the 2016 conference on empirical methods in natural language processing. 2016: 836-845.

[9] Meng R, Zhao S, Han S, et al. Deep keyphrase generation[J]. arXiv preprint arXiv:1704.06879, 2017.

[10] Zhang Y, Fang Y, Weidong X. Deep keyphrase generation with a convolutional sequence to sequence model[C]//2017 4th International Conference on Systems and Informatics (ICSAI). IEEE, 2017: 1477-1485.

[11] Chen W, Gao Y, Zhang J, et al. Title-Guided Encoding for Keyphrase Generation[C]//Proceedings of the AAAI Conference on Artificial Intelligence. 2019, 33: 6268-6275.

[12] Hasan K S, Ng V. Automatic keyphrase extraction: A survey of the state of the art[C]//Proceedings of the 52nd Annual Meeting of the Association for Computational Linguistics (Vol

ume 1: Long Papers). 2014: 1262-1273.

业务合作

业务合作 在线留言

在线留言 在线咨询

在线咨询